来源:映维网 作者

苹果正在开发一种可以根据平面视频内容生成混合现实或虚拟现实环境的技术。

美国专利商标局日前公布了一份名为“Method And Device For Generating A Synthesized Reality Reconstruction Of Flat Video Content(根据平面视频内容生成合成现实重构的方法和设备)”的苹果专利申请。作为说明,苹果一般在专利中将XR称为计算机生成现实(Computer-Generated Reality;CGR)或合成现实(Synthetic Reality;SR)。CGR和SR包含虚拟现实、增强现实和混合现实。

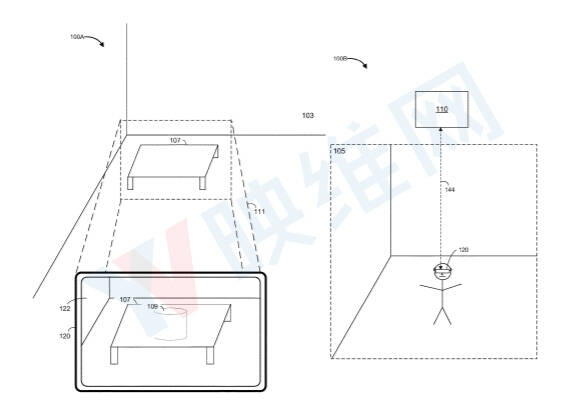

根据专利的技术,用户可以通过iPad或iPhone等手持式设备体验SR体验。但发明主要描述了如何通过平面视频内容生成SR角色、对象和环境。换句话说,这种技术应该可以把电视节目变成一个用户可以身临其境地进行探索的沉浸式现实环境。

苹果在专利中写道:“用户可能希望体验诸如电视剧或电影等视频内容,以一种他/她与角色同在一个场景中一样。换言之,用户希望将视频内容变成SR体验,而不是简单地通过电视或其他显示设备浏览。”

文件指出,大多数SR内容都是提前“精心创建”,并添加到用户可以选择的库中。但发明描述了一种通过“利用数字资产”来“无缝地、快速地”将平面内容导入SR体验,从而生成基于视频的按需型SR内容重建方法。

具体来说,系统通过识别场景中的“情节执行者”,合成场景描述,并“根据场景的场景描述驱动与第一情节执行者相关联的第一数字资产”来生成场景的重建”。

“情节执行者”定义为内容中的角色或演员。

系统可以根据视频内容生成SR重建,同时可以从相关文本内容和外部数据中提取信息。这可以是视频片段中演员的照片,演员的身高和尺寸,场景的各种视图,以及其他数据。

“在一个实现中,数字资产至少部分地根据视频内容和与视频内容相关联的外部数据动态生成。在一个实现中,与视频内容相关联的外部数据对应于演员的图片、演员的高度和其他测量、集合和对象的各种视图(如平面、侧面、透视图等)和/或诸如此类的视图。”

另外,一个类似的SR生成系统可以根据音频和相关内容创建交互式场景,包括有声读物、广播剧和其他纯音频内容。

专利同时说明了可执行对象(角色与之交互的对象)和不可执行对象之间的区别,而这种区别可允许SR系统提前知道场景中需要交互的对象类型。

相关专利:Method And Device For Generating A Synthesized Reality Reconstruction Of Flat Video Content

名为“Method And Device For Generating A Synthesized Reality Reconstruction Of Flat Video Content(根据平面视频内容生成合成现实重构的方法和设备)”的苹果专利申请最初在2019年1月提交,并在日前由美国专利商标局公布。需要注意的是,这只是一份专利申请,尚不确定苹果是否会或将于何时商业化所述的发明技术。